Как стать AI-разработчиком в 2025

Что Вы узнаете:

Содержание

Toggle- Какие навыки нужны для работы AI-разработчиком

- Какие языки программирования использовать в AI-разработке

- Где обучаться искусственному интеллекту с нуля

- Какие курсы и ресурсы помогут стать AI-специалистом

- Сколько зарабатывают AI-разработчики в 2025 году

Искусственный интеллект — одна из самых перспективных сфер, в которой спрос на специалистов только растет. В 2025 году AI-разработчики будут играть ключевую роль в IT-индустрии, создавая умные алгоритмы, автоматизируя процессы и разрабатывая передовые технологии. Если вы хотите войти в эту сферу, важно понимать, какие навыки и инструменты необходимы, с чего начать обучение и где найти первые заказы. В этой статье мы разберем, как шаг за шагом стать AI-разработчиком и построить карьеру в этой захватывающей области.

Ошибки в обучении нейронных сетей: почему классический ML не всегда нужен

Одной из самых больших ошибок является стремление углубляться в изучение классического машинного обучения и нейронных сетей. Это профессия, которая, скорее всего, будет вырождаться в ближайшие годы. Все больше компаний отказываются от кастомного обучения нейросетей, поскольку современные модели, такие как GPT, Llama или DeepSeek, уже справляются с поставленными задачами без необходимости в дополнительной настройке.

Перспективы AI Research: что ждет специалистов в будущем

Да, определенное количество крупных компаний все еще будет разрабатывать свои фундаментальные модели, однако это уже относится к области AI Research. Это, в свою очередь, требует гораздо более глубоких знаний, что делает профессию разработчиков баз данных более актуальной, чем создание кастомных нейросетей. В мире AI Research работать будут в основном топовые специалисты с PhD, и их будет требоваться меньше, чем специалистов по данным (data scientists), которых уже слишком много на рынке.

Зачем знать ML: основа для развития

В то же время, основы машинного обучения все-таки будут полезны, но для этого есть другие пути. Прежде всего, это может быть необходимо для создания прототипов, генерации идей для внедрения ИИ в бизнес-процессы и решения сложных задач. Однако, скорее всего, вам не придется разрабатывать нейронки с нуля.

Как применить AI на практике: три пути для старта

Технический порог входа в мир искусственного интеллекта сейчас значительно снижен, и главное, что нужно — это найти правильное место для его применения. Вот несколько вариантов, как можно начать работать с AI:

- Создавать петпроекты. Это отличный способ изучить технологии, познакомиться с возможностями и инструментами AI. Важно понимать, что для того чтобы выжать максимальную пользу из таких проектов, они должны решать реальные задачи, а не быть просто экспериментами ради экспериментов.

- Работать в AI-стартапах. Конечно, стартапы — это более динамичные и инновационные компании, но без опыта работы с базами данных вам будет сложно получить нужный опыт. Стартапы ищут специалистов с практическими навыками, которые способны решать реальные проблемы. Но, если вам удастся попасть в такую компанию, это будет бесценный опыт.

- Внедрить AI в текущую работу. Это путь, по которому пошел я. Два с половиной года назад я предложил внедрить новую фичу, которую давно просили клиенты. Однако сделать это классическими методами было невозможно, и я решил применить возможности AI. Этот путь оказался не только успешным, но и дал мне ценные знания о том, как эффективно использовать ИИ в реальных бизнес-процессах.

Как сделать первый шаг к внедрению AI: процесс от идеи до продакшн

- Прототипирование (Proof of Concept). На первом этапе важно создать прототип, который поможет продемонстрировать идею на практике. Это важный шаг, потому что помогает понять, стоит ли вообще углубляться в проект.

- Получение одобрения от бизнеса. Не менее важным этапом является получение одобрения от бизнеса, потому что, в конце концов, ваша идея должна быть ценна для компании. Нужно показать, как использование AI может улучшить существующие процессы или решить проблемные области.

- Сбор и подготовка данных для итераций. На этом этапе важно правильно организовать сбор и валидацию данных, что является важной частью работы с любыми ИИ-технологиями. Нужно убедиться, что данные имеют высокое качество и релевантность.

- Итерации и оттачивание моделей. Этот этап включает в себя множество циклов работы, тестирования и усовершенствования моделей. Здесь потребуется опыт в менеджменте и координации процессов, так как изменения и улучшения должны быть основаны на реальных данных и результатах.

- Продакшн. И, наконец, после нескольких итераций и доработок, ваш проект готов для внедрения в продуктивную среду. Это критически важный этап, который требует внимательности к деталям и грамотного управления.

Разберу шаги на примере моего первого AI проекта

1. Прототип

Тут даже кодить не всегда нужно. Просто берем нужные нам данные, засовываем в ChatGPT и пишем промпты, пока не получится что-то сносное

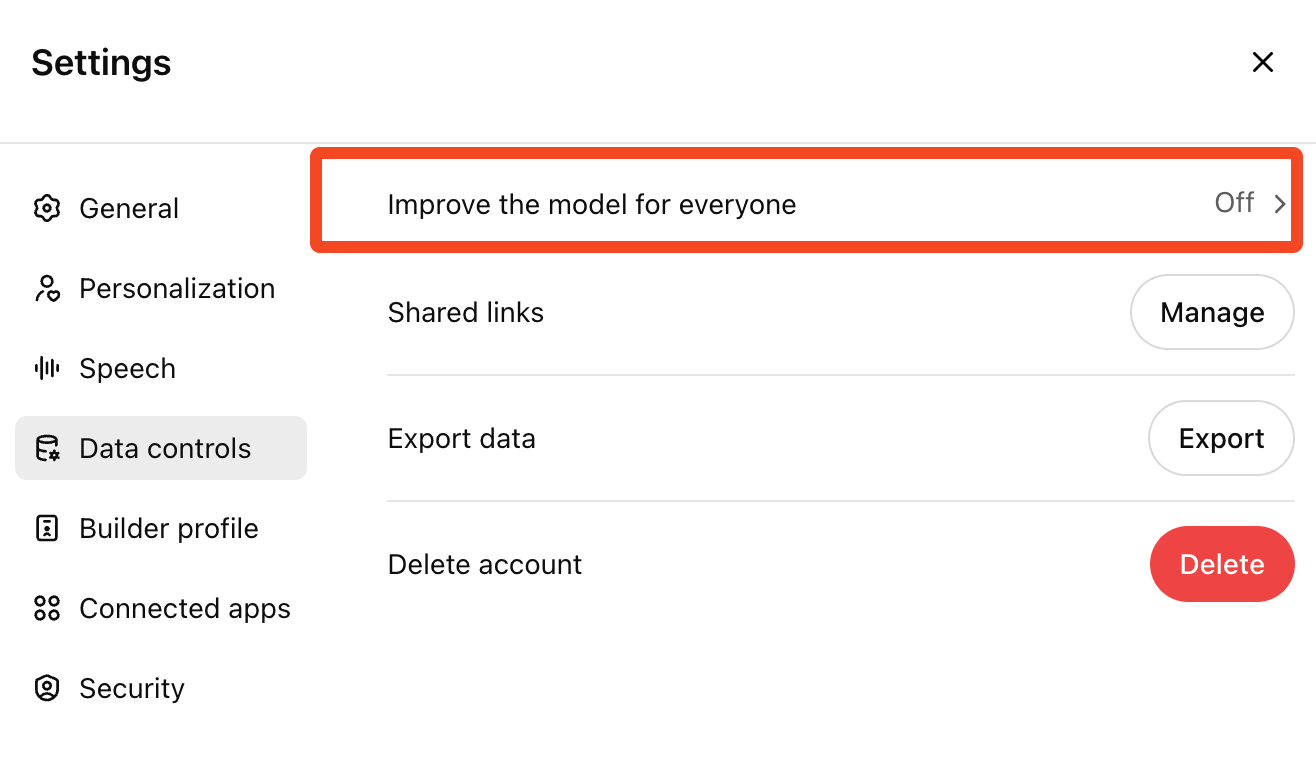

Не забываем отключить использование ваших данных для обучения моделей

Я просто выкачал несколько решений кандидатов, подставлял их по одному и вручную прописывал логику для оценки по нескольким критериям, на которые я бы смотрел вручную (типа именования переменных, модульности, читабельности функций, и т.д.)

2. Одобрение от бизнеса

Получаем норм результат на нескольких примерах, идем показывать начальству, выбиваем аппрув на проект + ресурсы на разметку данных. Особенно круто, если подготовить какие-то данные, что эта фича реально нужна.

Например, посчитанное в человекочасах время на процесс, который оптимизируете, или отзывы пользователей, где они жалуются на отсутствие фичи или чего-то смежного.

3. Сбор данных

Это вообще самый важный пункт, потому что shit in => shit out. Ну и глобально, оптимизируется то, что измеряется.

Тут два важных шага

- сбор самих данных (что на вход идет)

- сбор разметки (ожидаемый ответ идеальной системы)

Валидация данных: как избежать ошибок в процессе оценки

Очень важно помнить, что используемые данные — это не для обучения моделей в традиционном смысле. Мы не обучаем нейросети, а валидацируем разные подходы, чтобы точно выбрать лучший и показать метрики бизнесу. Этот процесс требует особого внимания к качеству данных и способу их разметки.

1. Собираем репрезентативные данные

Данные должны покрывать все возможные случаи, с которыми может столкнуться система. В моем случае, это решения, выполненные на разных языках, с различной успешностью и разной длиной. Ключевое здесь — собрать такой объем данных, который будет отражать широкий спектр реальных входных данных, а не ограничиваться лишь типичными примерами.

2. Как правильно разметить данные

Разметка данных — критически важный этап. Для того чтобы гарантировать высокое качество, я привлек 10 разных разработчиков в компании и попросил их оценить код по 5-балльной шкале. При этом каждый пример кода оценивался двумя разметчиками, и важно было минимизировать вероятность того, что два одинаковых примера попадут в одну пару для оценки.

Почему так сложно?

Такой подход помогает минимизировать bias — предвзятость восприятия конкретным разметчиком или парой разметчиков. Это важно для того, чтобы оценка была как можно более объективной. Для этого я использовал специальные скрипты для рандомного распределения примеров между разметчиками.

3. Грабли, на которые стоит наступить

В процессе работы я допустил пару ошибок. Одна из них — это позднее осознание того, что нужно отфильтровать все элементы, где мнения разметчиков сильно расходились. Это важный момент, потому что если мы сами не можем договориться о том, как правильно оценить код, то будет сложно объективно оценивать качество модели, основанной на таких данных.

4. Абсолютные оценки — плохой выбор

Одной из самых больших проблем стало использование абсолютных оценок. Например, код мог быть оценен на 4 из 5 баллов, но такие оценки часто оказываются неточными и не дают подробной картины. Люди не всегда точно оценивают по пятибалльной шкале, и в таких случаях могут возникать флуктуации на 10-20 баллов. Это делает анализ данных малопродуктивным.

5. Идея с относительной оценкой

Правильнее было бы использовать систему относительных оценок, когда разметчику показывают два примера кода и просят выбрать лучший. Такой метод позволяет избежать крайностей и получить более точные результаты, особенно когда оценки очень схожи. Отлично бы подошла система, похожая на рейтинг ЭЛО, используемая в шахматах.

6. Отложенная выборка данных

Очень важный момент, о котором часто забывают, — это необходимость отложить часть данных и не использовать их на протяжении всего процесса разработки. Речь идет о 20% данных, которые должны быть скрыты и использоваться только в последнюю очередь.

Это связано с проблемой train-test data leakage. Даже если мы не обучаем модель в традиционном понимании, процесс создания системы через перебор промптов и комбинирование запросов все равно может привести к «обучению» на данных. Поэтому важно провести финальную проверку качества системы на этих отложенных данных, чтобы оценить её работу без искажений.

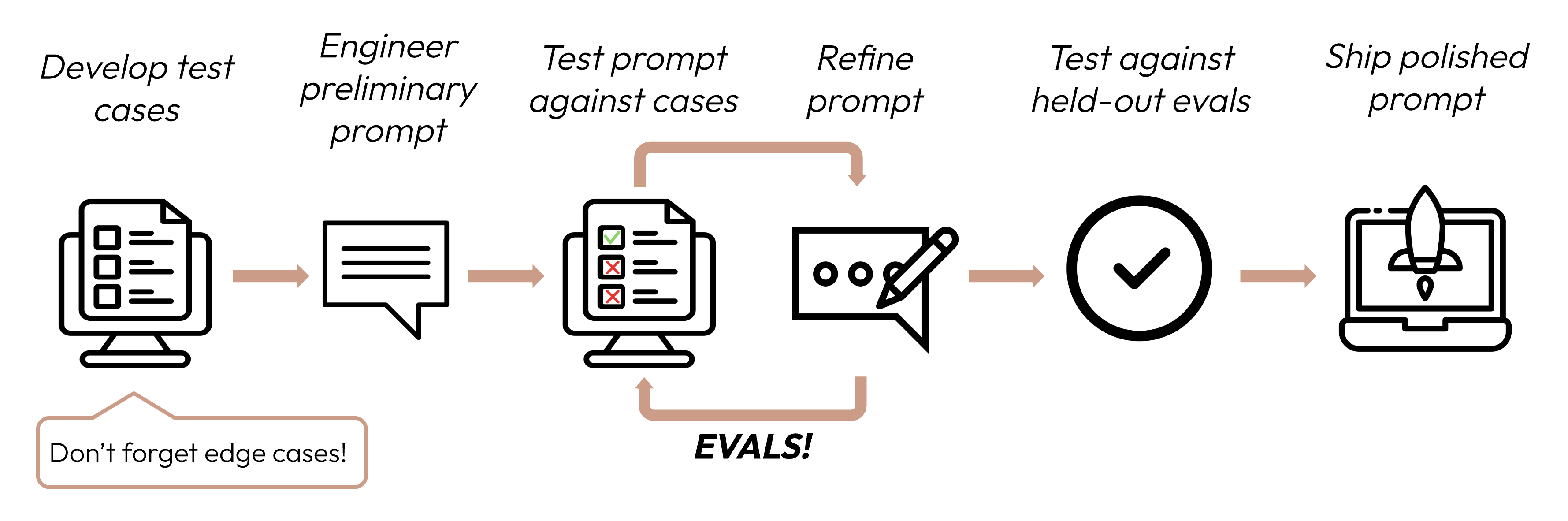

4. Итерации

Большую часть времени после сбора данных мы проводим вот в этом цикле посередине

Хорошо, когда наши аутпуты легко проверить на корректность. Например, оценка кода, или id релеватного блока документации для AI техподдержки. Тогда мы просто сравниваем 1 в 1 (для id) или считаем ошибку (для оценки).

А что если мы делаем саммари статей? Как понять, что сгенерированное саммари достаточно хорошее в сравнении с «идеальным» из нашего тестового датасета? Посимвольное сравнение точно не сработает – текст может отличаться кардинально, при этом по смыслу очень хорошо попадать.

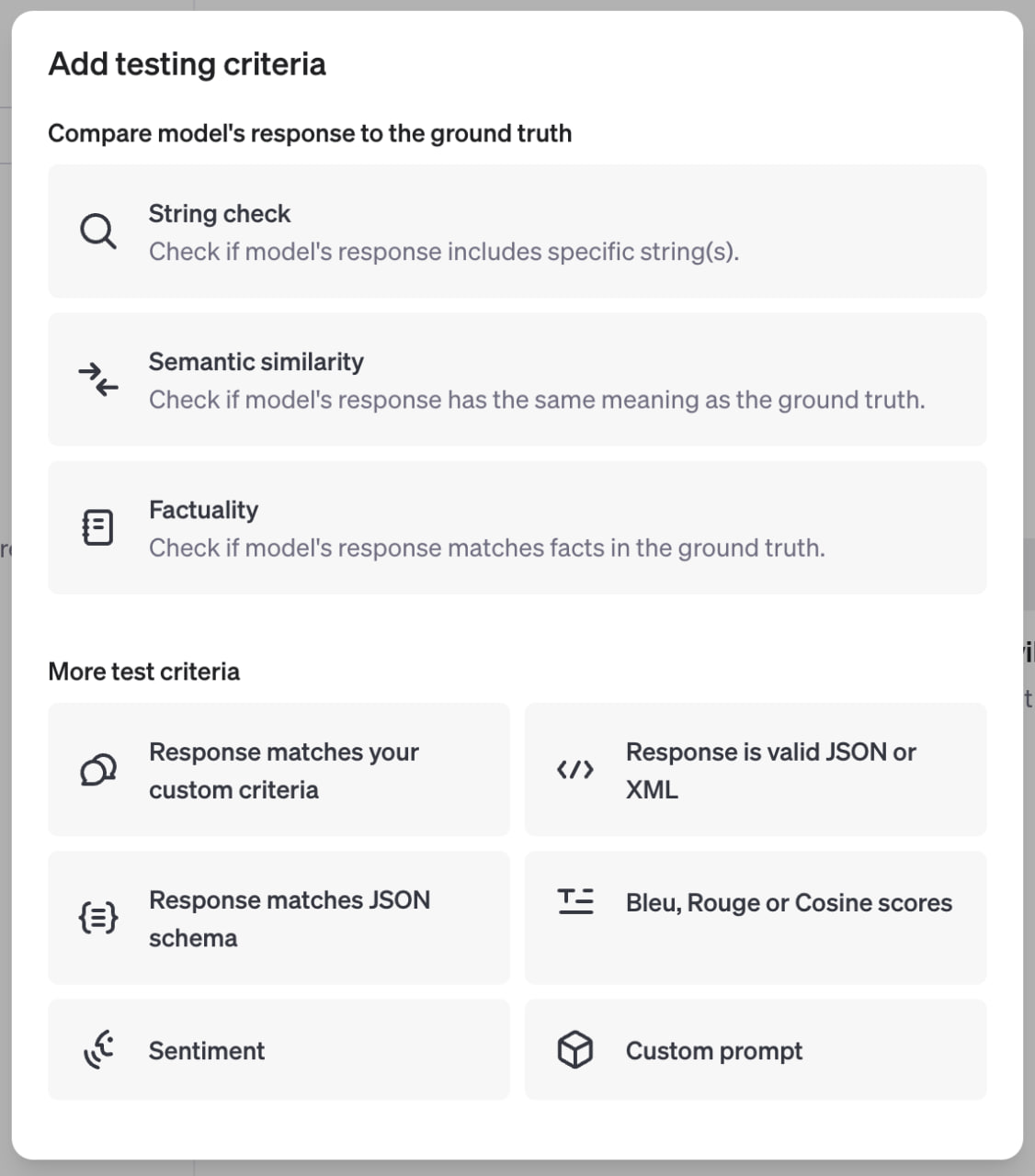

Тут можно много костылей нагородить, но я сразу скажу про OpenAI Evals – новый встроенный инструмент. Есть не только вездесущее семантическое сравнение на ембеддингах, но и фактологическое, что гораздо полезнее. И вообще позволяет задать любые (!) кастомные критерии.

На практике, часто вижу, что многие не греют себе голову с тесткейсами – просто смотрят на результат генераций на нескольких примерах, и интуитивно итерируют промпты. Такой вайбчек. Вполне имеет место быть, так что начинать можно вообще без заморочек с разметкой (но я делал не так 🤷♂️)

Хорошие LLM пайплайны часто напоминают хорошо выстроенные процессы в компаниях. А хорошие промпты – хорошие инструкции или документацию. Попытайтесь думать про LLM систему не как про обычный код, а как про набор умных студентов 3-4 курса, у которых почти нет контекста про ваш бизнес, но которых вам нужно организовать. Реально помогает

5. Продакшн

Тут возникают проблемы, которых не было во время локальных итераций. Выбираем на свой вкус, где стелить соломку:

- Fallback на других провайдеров, если OpenAI не отвечает

- Добавляем жесткие таймауты (частый кейс, что при большом количестве одновременных запросов, небольшая часть из них выполняется сильно дольше)

- Делаем retry + exponential backoff на случай пробития лимитов по токенам или запросам в секунду. Особенно критично, когда у вас низкий уровень аккаунта.

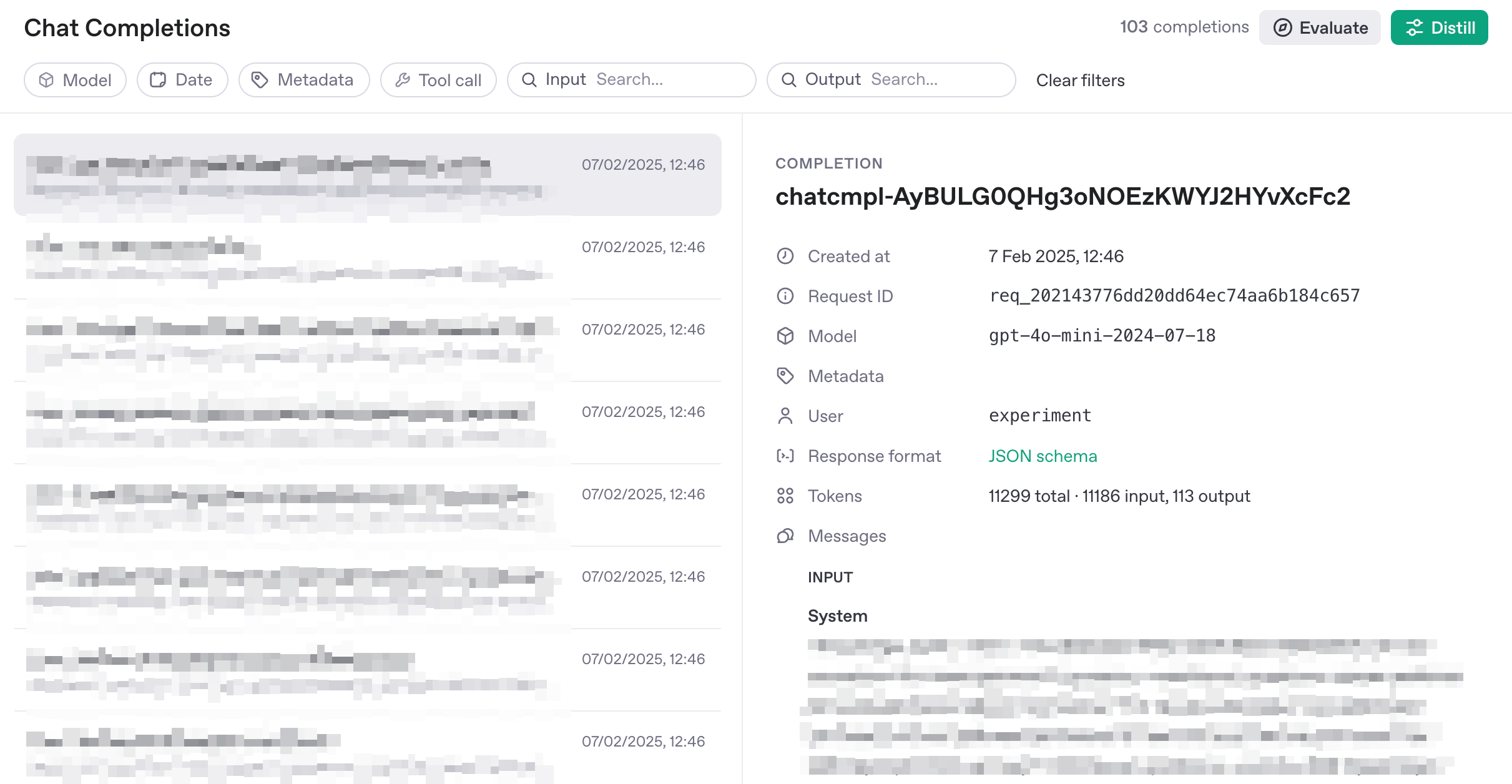

> из документации не очевидно, но уровень определяется суммой трат, а не пополнений, так что просто закинуть денег – не увеличит лимиты. - Логгирование и мониторинги. Сохранять все пары вход-выход – супер полезно. Плюс знать, сколько токенов и когда потрачено. Можно слать руками в какую-нибудь графану, можно использовать специализированные тулзы вроде lunary, а можно использовать новое встроенное логгирование от OpenAI (

store=True).

Окно в интерфейсе OpenAI, где можно посмотреть сохраненные запросы.

P.s. Справа вверху две крутые волшебные кнопкиМожно еще мониторить data drift, аномалии и т.д., но это даже не следующий уровень, так что забейте пока.

- Если в запросах есть инпуты конкретного пользователя, добавляем его id в запрос через параметр user. Если какие-то запросы будут нарушать политику OpenAI, это поможет и найти нарушителя, и с OpenAI разобраться (вот мол, конкретный юзер косячит, мы сами белые пушистые, а пользователя уже заблочили).

Что дальше?

- Прочитать методичку про промптингу или тут (https://www.promptingguide.ai/)

- Восхититься идеей ембеддингов

- Разочароваться в ней

- Научиться работать со structured_outputs, чтобы структура ответа модели была детерминированной

- Начать использовать LangChain, чтобы понять, что вы это зря.

- Потратить кучу времени итерируясь над промптами в реальных задачах, чтобы обучить свою нейросетку в голове.

- Научиться делать мониторинг (и самих ответов, и метрик, и костов, и ошибок, и дрифта входных данных)